Un avocat australian a fost nevoit să-și ceară public scuze după ce a depus la tribunal un memoriu conținând citate juridice inventate de un program de inteligență artificială. Incidentul a avut loc în cadrul unui proces pentru crimă, derulat la Curtea Supremă din statul Victoria.

Avocatul apărării, deținător al titlului prestigios de King’s Counsel, a recunoscut că a inclus în concluzii referințe false, generate automat de un soft. Printre acestea s-au numărat citate din discursuri parlamentare inexistente și decizii judecătorești inventate.

„Îmi asum întreaga responsabilitate și îmi exprim profunda regretare pentru această eroare”, a declarat el în fața instanței.

Problema a fost descoperită de către echipa judecătorului, care a solicitat verificarea surselor. La analiză, s-a constatat că unele citate nu existau în realitate, iar altele erau complet fictive.

Reprezentanții apărării au explicat ulterior că au verificat parțial conținutul, dar au presupus în mod eronat că toate referințele sunt corecte. Eroarea a condus la amânarea soluționării cauzei cu o zi.

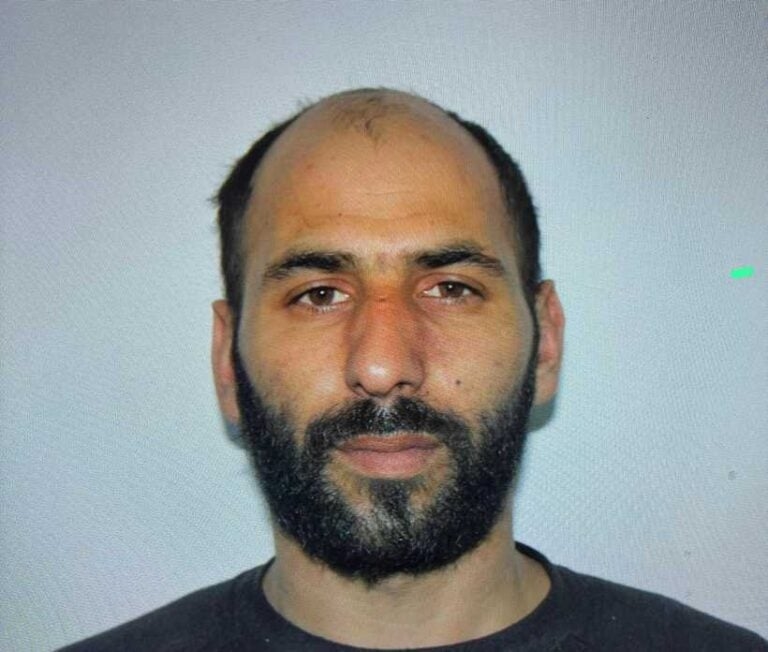

În urma anchetei, instanța a stabilit că cel acuzat, un minor a cărui identitate nu a fost divulgată, nu poate fi tras la răspundere penală din cauza unor probleme de sănătate mentală.

Judecătorul a reamintit că utilizarea necontrolată a tehnologiei poate afecta serios administrarea justiției. „Acuratețea informațiilor prezentate de avocați este esențială. Instrumentele automatizate trebuie verificate meticulos”, a subliniat el.

Acest caz nu este izolat. Anul trecut, în Statele Unite, doi avocați au fost sancționați pentru depunerea de documente conținând cercetări fictive, generate cu ajutorul unui chatbot. De asemenea, în Marea Britanie, instanțele au emis avertismente specifice privind riscurile reprezentate de inteligența artificială în procesul juridic.

Specialiștii avertizează că astfel de instrumente pot produce așa-numite „halucinații”, adică informații aparent credibile, dar complet false, care subminează încrederea în sistemul de justiție.